ディープシーク, 急成長を遂げる中国の人工知能 (AI) 最近注目を集めているスタートアップ, 誤ってデータベースの1つをオンライン上に公開してしまった. このセキュリティ上の欠陥により、サイバー犯罪者が機密性の高い情報にアクセスできた可能性がある。.

によると Wizのセキュリティ研究者Gal Nagli氏, 誤って設定されたClickHouseデータベースに完全な管理権限が付与されました, 権限のないユーザーが制限なく内部データにアクセスできるようになる.

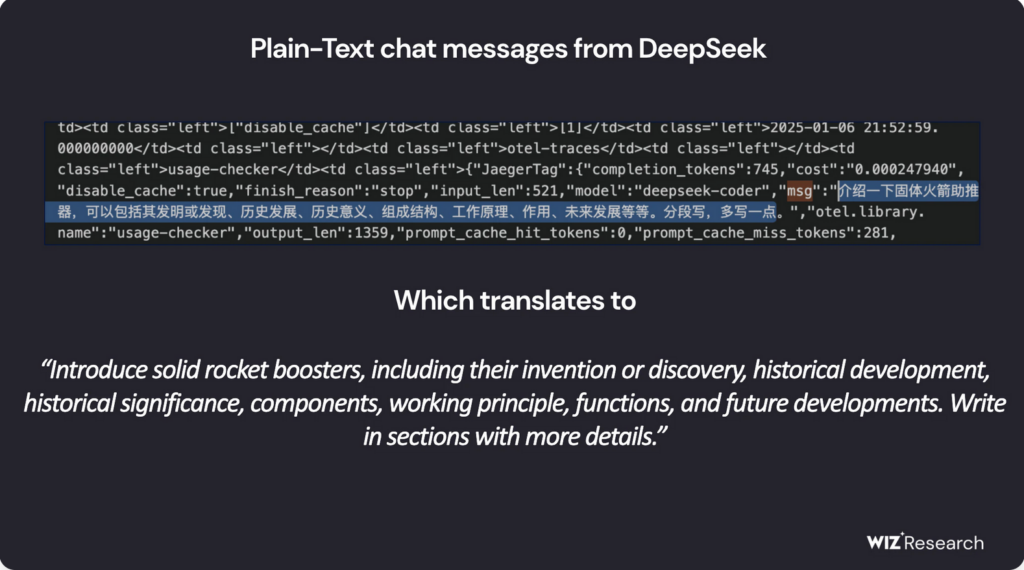

漏洩したデータベースには、 100万行を超えるログストリーム, チャット履歴を含む, バックエンドの詳細, APIシークレット, 秘密鍵, その他の重要な運用メタデータ. ウィズからの複数回の接触の試みの後, DeepSeekはその後、脆弱性を保護した。.

この記事が公開された時点では, DeepSeek AIのサービスに登録できませんでした, 次のメッセージが表示されました:

DeepSeek は機密データへの無制限のアクセスを許可します

侵害されたデータベース, oauth2callback.deepseek でホスト[.]com:9000 および dev.deepseek[.]com:9000, 無制限の入国を許可 幅広い機密データ. ウィズの研究者は、この暴露によりデータベースの完全な制御がもたらされる可能性があると警告した。, 無許可 特権の昇格, およびデータの活用 – 認証を必要とせずに.

さらに, 攻撃者はClickHouseのHTTPインターフェースを利用して SQLクエリを実行する ウェブブラウザから直接. この時点で, 問題が解決される前に、悪意のある人物が侵入したり、公開されたデータを抽出したりしたかどうかは不明です。.

「適切なセキュリティ対策を講じずにAIサービスを急速に導入することは、深刻なリスクをもたらす」,ナグリ氏はハッカーニュースへのコメントでこう述べた。. 「AIセキュリティに関する議論は長期的な脅威に焦点を当てることが多いが、, 差し迫った危険は、多くの場合、データベースの偶発的な漏洩など、基本的なセキュリティの見落としから生じます。」

彼はさらに、ユーザーデータの保護が最優先事項であり続ける必要があると強調した。, 将来同様の事件を防ぐために、セキュリティチームにAI開発者と緊密に協力するよう促す.

DeepSeek が規制当局の監視下に置かれる

DeepSeekは最近、最先端のオープンソースAIモデルで高い評価を得ている。, 業界リーダーのような強力な競争相手としての地位を確立している。 OpenAI. R1推論モデルは、AIの分野を混乱させる可能性を秘めていることから「AIのスプートニクの瞬間」と呼ばれています。.

同社のAIチャットボットの人気が急上昇, 複数の国でAndroidとiOSの両方のアプリストアランキングでトップに. でも, その急速な拡大により、 大規模なサイバー攻撃, セキュリティ上の脅威を軽減するために、DeepSeekはユーザー登録を一時的に停止するよう促した。.

技術的な脆弱性を超えて, 同社は規制当局の監視も受けている. DeepSeekのデータ処理をめぐるプライバシーの懸念, その 中国起源, 米国で国家安全保障上の警戒が高まっている.

法的課題

重要な進展として, イタリアのデータ保護規制当局は最近、DeepSeekのデータ収集方法とトレーニングソースの詳細を要求した。. その後まもなく, 同社のアプリはイタリアでは利用できなくなった, この動きが規制当局の調査に対する直接的な対応であったかどうかは不明である。.

その間, DeepSeekは、OpenAIのアプリケーションプログラミングインターフェースを不適切に利用した可能性があるという疑惑にも直面している。 (API) 独自のモデルを開発する. ブルームバーグのレポート, フィナンシャル・タイムズ, ウォールストリートジャーナルは、OpenAIとマイクロソフトの両社が、ディープシークがAI蒸留と呼ばれる無許可の行為に関与していたかどうかを調査していると報じている。これは、別のAIシステムによって生成された出力に基づいてモデルをトレーニングする手法である。.

AI蒸留についての詳細

AI蒸留, としても知られている 知識の蒸留, 機械学習の技術で、小さな, より効率的なAIモデルは、より大きな出力を使用してトレーニングされます, より複雑なモデル. この方法により、開発者は強力なAIから知識を転送することができる。 (教師モデル) 軽量AIに (学生モデル) 能力を維持しながら.

もともと効率を高め、計算コストを削減するために設計された, 蒸留はAI開発において広く使われる手法となっている. でも, 適切な許可なしに行われる場合(独自のAIモデルから知識を抽出するなど)、深刻な倫理的および法的懸念が生じる。.

「私たちは、 [中国] 積極的に取り組んでいます 先進的な米国を再現する. AIモデル 蒸留などの技術を通じて,オープンAIの代表者はガーディアン紙にこう語った。.

AI分野でのDeepSeekの急速な成長により, 安全性に関する懸念, 規制遵守, 倫理的なデータ慣行が強化されている. これらの問題に対する同社のアプローチは、世界のAI分野での長期的な成功を形成する上で重要な要素となるだろう。.