Recherche profonde, une intelligence artificielle chinoise en pleine croissance (AI) startup qui a récemment attiré l'attention du grand public, a laissé par inadvertance l'une de ses bases de données exposée en ligne. Cette faille de sécurité aurait pu donner aux cybercriminels accès à des informations extrêmement sensibles.

Selon Gal Nagli, chercheur en sécurité chez Wiz, la base de données ClickHouse mal configurée a accordé un contrôle administratif complet, permettre aux utilisateurs non autorisés d'accéder aux données internes sans restrictions.

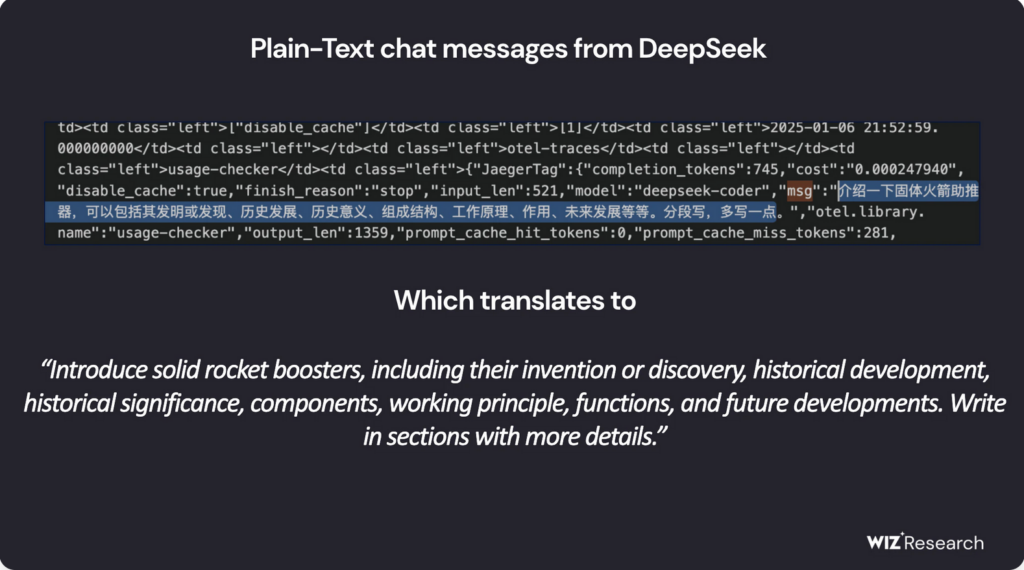

La base de données exposée contiendrait plus d'un million de lignes de flux de journaux, y compris les historiques de discussion, détails du backend, Les secrets de l'API, clés secrètes, et d’autres métadonnées opérationnelles critiques. Suite à plusieurs tentatives de contact de Wiz, DeepSeek a depuis sécurisé la vulnérabilité.

Il convient de mentionner qu'au moment de la publication de cet article, nous n'avons pas pu nous inscrire au service DeepSeek AI, comme le message suivant est apparu:

DeepSeek permet un accès illimité aux données sensibles

La base de données compromise, hébergé sur oauth2callback.deepseek[.]avec:9000 et dev.deepseek[.]avec:9000, autorisé l'entrée sans restriction à un large éventail de données confidentielles. Les chercheurs de Wiz ont averti que l'exposition aurait pu conduire à un contrôle complet de la base de données, non autorisé escalade de privilège, et l'exploitation des données – sans avoir besoin d'aucune authentification.

En outre, les attaquants auraient pu utiliser l'interface HTTP de ClickHouse pour exécuter des requêtes SQL directement depuis un navigateur Web. À ce point, il n'est pas certain que des acteurs malveillants aient réussi à infiltrer ou à extraire les données exposées avant que le problème ne soit résolu.

« L’adoption rapide des services d’IA sans mesures de sécurité adéquates présente de graves risques," Nagli a déclaré dans un commentaire à The Hacker News. « Alors que les discussions autour de la sécurité de l’IA se concentrent souvent sur les menaces à long terme, « Les dangers immédiats découlent souvent d’erreurs de sécurité fondamentales, comme l’exposition accidentelle d’une base de données. »

Il a également souligné que la protection des données des utilisateurs doit rester une priorité absolue., exhortant les équipes de sécurité à travailler en étroite collaboration avec les développeurs d'IA pour éviter des incidents similaires à l'avenir.

DeepSeek sous surveillance réglementaire

DeepSeek a récemment acquis une reconnaissance pour ses modèles d'IA open source de pointe, se positionnant comme un concurrent redoutable face aux leaders du secteur comme OpenAI. Son modèle de raisonnement R1 a été surnommé « le moment Spoutnik de l'IA » pour son potentiel à perturber le domaine.

Le chatbot IA de l'entreprise a gagné en popularité, en tête des classements des magasins d'applications sur Android et iOS dans plusieurs pays. Cependant, son expansion rapide en a également fait une cible pour cyberattaques à grande échelle, incitant DeepSeek à suspendre temporairement les inscriptions d'utilisateurs pour atténuer les menaces de sécurité.

Au-delà des vulnérabilités techniques, la société a également fait l'objet d'un examen réglementaire. Préoccupations en matière de confidentialité concernant les pratiques de DeepSeek en matière de données, couplé à son Origines chinoises, ont déclenché des alarmes de sécurité nationale aux États-Unis.

Défis juridiques

Dans un développement significatif, Le régulateur italien de la protection des données a récemment demandé des détails sur les méthodes de collecte de données et les sources de formation de DeepSeek. Peu de temps après, les applications de l'entreprise sont devenues indisponibles en Italie, bien qu'il ne soit pas clair si cette décision était une réponse directe aux demandes réglementaires.

En attendant, DeepSeek est également confronté à des allégations selon lesquelles il aurait exploité de manière inappropriée l'interface de programmation d'applications d'OpenAI (API) développer ses propres modèles. Des rapports de Bloomberg, Le Financial Times, et le Wall Street Journal indiquent qu'OpenAI et Microsoft enquêtent pour savoir si DeepSeek s'est livré à une pratique non autorisée connue sous le nom de distillation d'IA, une technique qui consiste à former des modèles sur des sorties générées par un autre système d'IA..

En savoir plus sur AI Distillation

Distillation d'IA, également connu sous le nom distillation des connaissances, est une technique d'apprentissage automatique où un plus petit, un modèle d'IA plus efficace est formé à l'aide des résultats d'un plus grand, modèle plus complexe. Cette méthode permet aux développeurs de transférer les connaissances d'une IA puissante (le modèle de l'enseignant) à une IA légère (le modèle étudiant) tout en préservant ses capacités.

Conçu à l'origine pour améliorer l'efficacité et réduire les coûts de calcul, la distillation est devenue une pratique largement utilisée dans le développement de l'IA. Cependant, lorsqu'elle est effectuée sans autorisation appropriée — comme l'extraction de connaissances à partir de modèles d'IA propriétaires — elle soulève de graves problèmes éthiques et juridiques.

« Nous sommes conscients que des groupes dans [Chine] travaillent activement à répliquer les États-Unis avancés. Modèles d'IA grâce à des techniques telles que la distillation," a déclaré un représentant d'OpenAI au Guardian.

Avec la croissance rapide de DeepSeek dans le secteur de l'IA, préoccupations concernant sa sécurité, Conformité réglementaire, et les pratiques éthiques en matière de données se sont intensifiées. L’approche de l’entreprise sur ces questions sera un facteur clé pour façonner son succès à long terme dans le paysage mondial de l’IA.